| Python爬虫总结 | 您所在的位置:网站首页 › python 请求https错误 › Python爬虫总结 |

Python爬虫总结

|

Python爬虫基础——HTML、CSS、JavaScript、JQuery网页前端技术Python爬虫基础——正则表达式Python爬虫基础——re模块的提取、匹配和替换Python爬虫基础——XPath语法的学习与lxml模块的使用【CSDN】Python爬虫进阶——JsonPath使用案例Python爬虫进阶——urllib模块使用案例【淘宝】Python爬虫进阶——Request对象之Get请求与URL编码【英雄联盟吧】Python爬虫进阶——Request对象之post请求案例分析【百度翻译】Python爬虫实战—— Request对象之header伪装策略Python爬虫实战——反爬策略之代理IP【无忧代理】Python爬虫实战——反爬策略之模拟登录【CSDN】Python爬虫实战——反爬机制的解决策略【阿里】Python爬虫总结——常见的报错、问题及解决方案

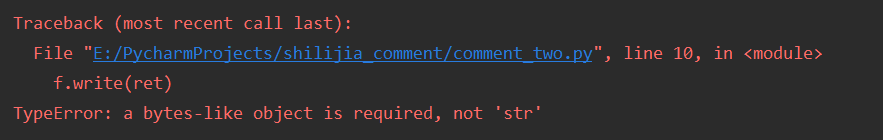

在爬虫开发时,我们时常会遇到各种BUG各种问题,下面是我初步汇总的一些报错和解决方案。 在以后的学习中,如果遇到其他问题,我也会在这里进行更新。 各位如有什么补充,欢迎评论区留言~~~ 问题:IP被封,或者因访问频率太高被拦截??? 解决方案之一:使用代理IP即可。 问题:正确使用XPath之后并没有输出??? 解决方案之一:XPath只能提取未注释的代码,改用正则表达式即可。 问题:容易被反爬搞死??? 解决方案之一:headers中都要带上User-Agent,而Cookie能不带则不带。 报错:

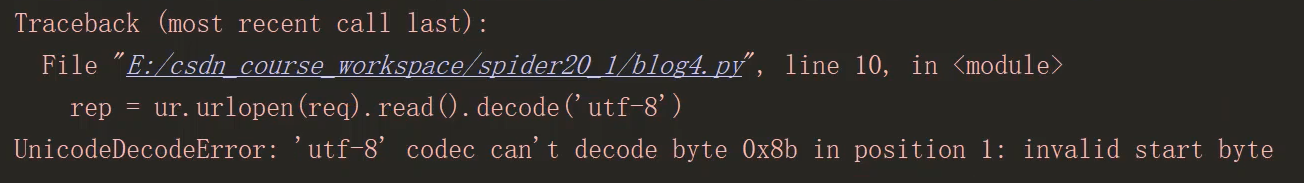

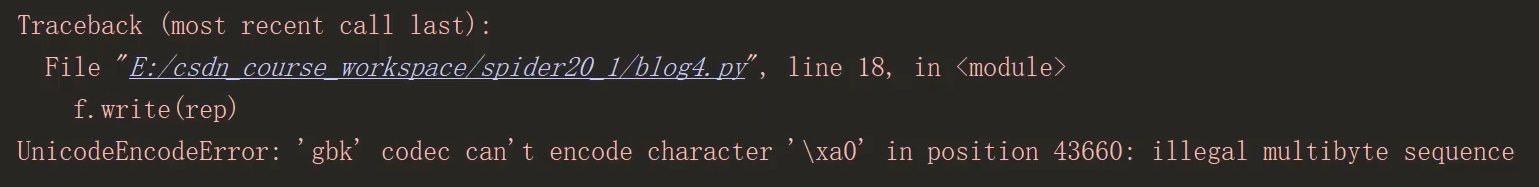

str通过encode()方法可以编码为指定的bytes; PS:反过来,如果我们从网络或磁盘上读取了字节流,那么读到的数据就是bytes。要把bytes变为str,就需要用decode()方法。 报错:

在headers中加入Cookie即可输出正常的HTML。 报错:

使用json.loads方法即可。 问题: url = 'https://tieba.baidu.com/f?kw=%E8%8B%B1%E9%9B%84%E8%81%94%E7%9B%9F&ie=utf-8&pn=0'网址复制到py文件中,却变成了“乱码”??? 解决方案之一:调用urllib.parse.unquote进行URL解码即可。 问题:

分析URL时,我们一般从第二页开始分析,而不是第一页。 问题:不想Cookie中携带自身账号内容??? 解决方案之一:利用浏览器的无痕窗口功能,进入网页再取Cookie即可。 报错: 解决方案之一: 报错: 解决方案之一:未完待续哦~~~~ 为我心爱的女孩~~ |

【本文地址】

公司简介

联系我们

类型错误:需要类似字节的对象,而不是字符串???

类型错误:需要类似字节的对象,而不是字符串??? UTF-8不能处理字节???

UTF-8不能处理字节??? ‘ gbk ’不能处理‘ \xa0 ’ ???

‘ gbk ’不能处理‘ \xa0 ’ ??? 输出结果是字节类型,json对象无法正常显示???

输出结果是字节类型,json对象无法正常显示??? URL地址不规范???

URL地址不规范???